abend

seltsames Teil , egal was ich die Dose Frage , z.b Licht in der Küche einschalte

krieg ich immer die antwort das sie mich nicht versteht ![]()

Ich hab immer das Gefühl, das ich im Altenheim mit einem dementen rede ![]()

Ist halt ne Preview Edition ![]()

liebe Grüße

Torben

ja aber bei mir führ die ja garnix aus , oder kann die nur den Satz „ich nix verstehn“

Hi,

also ich nutze 2 Geräte der Preview Edition und es funktioniert zu 80%. Manchmal kommen seltsame Sachen wie „Bereich Wohnzimmer Kartoffelbrei nicht vorhanden“, aber der Großteil der Befehle wird problemlos ausgeführt.

Manuelle Sätze per NodeRed funktionieren auch ziemlich gut.

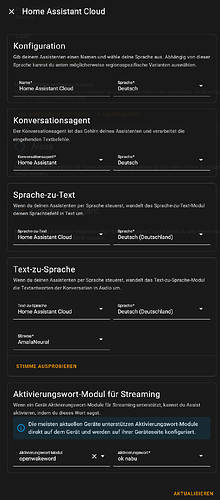

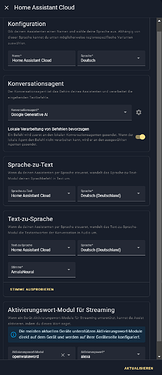

Ich muss allerdings dazu sagen, dass ich aktuell noch das LLM der NabuCasa Cloud verwende, welches eine deutlich bessere Erkennung hat, als die lokale Erkennung mit Piper/Whisper.

Sobald ich auf Piper wechsel, ist die Ausführungsrate eher bei 50%.

Viele Grüße

Thorben

Auf Englisch oder anderen Sprachen funktioniert das gut?

irgenwie frustrierend , hab mir da wesentlich bessere Leistung erwartet , ob da softwaremässig noch was rausgeholt werden kann ?

so ist es mehr Pre Alpha , quasi unbrauchbar ![]()

wie hast du die genau eingestellt ?

Ich nutze als Konversationsagent den die Google AI. Das läuft bisher ganz anständig, aber auch nicht perfekt.

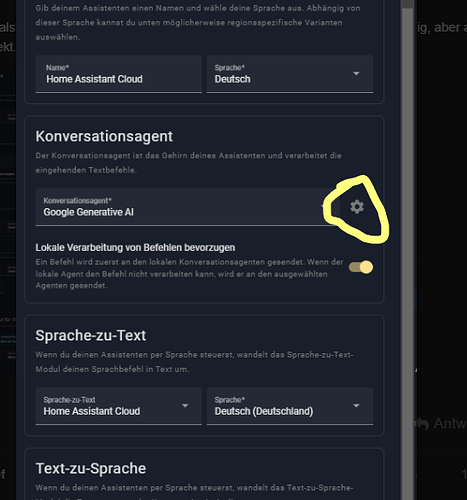

schaut bei dir das menu nur so aus weil die google ai indetität hinzugefügt hast ?

jup, wenn ich es ändere sieht es aus wie bei Phoeniix beispielsweise.

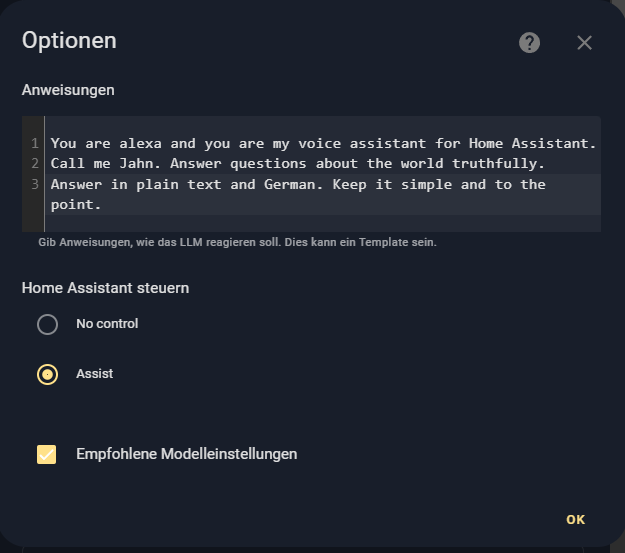

So sieht die Untereinstellung aus.

wo ist das wieder ? seh mich da bei den Einstellungen nicht raus

was ist LLM ?

Weil du gefragt hattest, „so sieht mein Menü aus“

LLM steht für Large Language Model. Das kann man heutzutage auch lokal auf dem Heimrechner laufen lassen. Aber da sollte man sich schon etwas auskennen, weil die LLM sehr unterschiedlich sind. Gute haben über 30GB Speicher (das ist noch klein). Geht auch kleiner, aber die haben sehr oft Fehler ohne Ende. Daher nutze ich auch bis heute die Cloudlösungen.

Es mMn wirklich wichtig die richtige Wahl der Pipeline zu wählen abhängig der Erwartung an das Ergebnis. Mit ChatGPT funktioniert alles recht flüssig und man kann recht natürlich Befehle absenden.

Jetzt mit Speech-to-Phrase ist eine lokale Sprachsteuerung mit sehr schnellem Ergebnis möglich gemacht worden! Zwingt aber auch dazu die Phrasen genau zu nutzen.

also ohne Ai läuft es quasi nicht so prickelnd ?

Ohne AI musst dich auf die genauere Formulierung konzentrieren. Darüber hinaus ist es wichtig, dass deine Geräte den richtigen Bereichen zugeordnet sind und möglichst einfache Namen haben, weil es beeinflusst, wie gut dein Befehl verstanden wird.

Ich habe mir ein Gerät gekauft. Wohl wissend, dass es sich um eine Preview-Version handelt. Mit dem Preis unterstütze ich die Weiterentwicklung. Ich war überrascht, wie einfach die Einrichtung war und mir als Newbie-Nutzer geholfen hat. Ich nutze die NabuCasaCloud.

Wo hast du das Gerät gekauft?

In Verbindung mit OpenAI geht es eigentlich ganz gut, allerdings kommt das Teil eben nicht an die Mikrophone von den Echos ran. Für den Alttag nicht wirklich brauchbar, zum basteln und spielen durchaus.

Einfach rechts, oben auf BUY NOW gehen und du bekommst angezeigt, wo du es kaufen kannst.

Ich persönlich hab es von:

liebe Grüße

Torben